2026年AI计算节点发展研究报告

时间:2026-04-13 16:38 来源:未知 作者:admin 点击:次

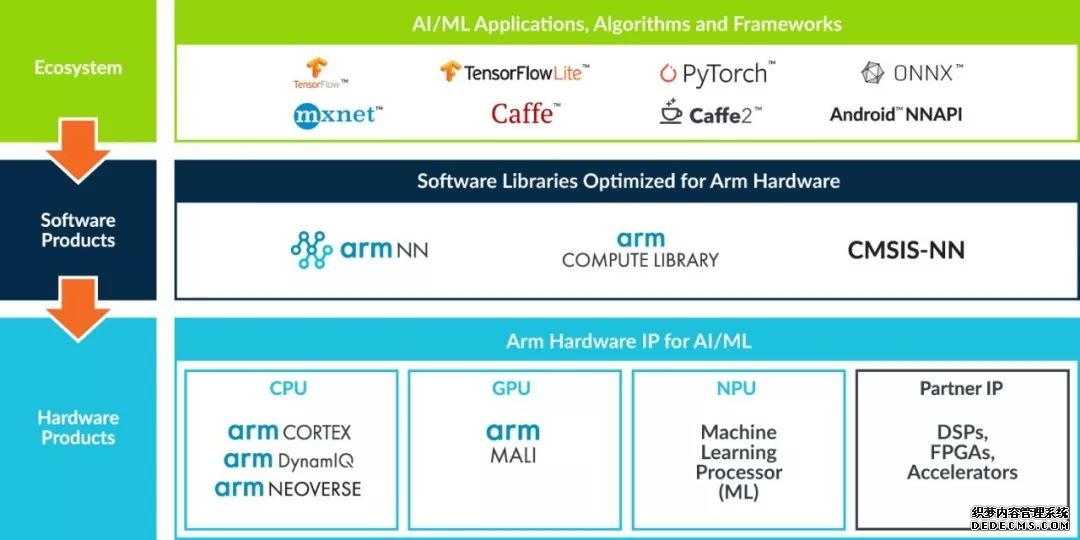

在人工智能技术狂飙突进的2026年,大模型参数规模从千亿迈向万亿,训练数据量也从TB级跃升至PB级。这场由“规模法则”驱动的智能革命,对底层算力提出了前所未有的挑战。传统的算力架构,无论是单芯片性能的“内存墙”瓶颈,还是集群扩展时的通信效率问题,都已难以支撑新一代AI应用的需求。在此背景下,一种名为“AI计算节点”的新型算力架构应运而生,正成为破解算力困局、构筑智能时代新基建的关键钥匙。 简单来说,AI计算节点并非一台传统服务器,而是一个通过超高速互联技术,将数十甚至上百张GPU等算力芯片紧密耦合而成的“超级计算单元”。它改变了以往以CPU为中心的连接模式,构建起以GPU高速互联为核心的紧耦合系统。其核心价值在于实现了“高密集约、高速超宽、高效灵活、高稳可靠”四大能力。这种架构通过NVLink等卡间直连技术,在节点内实现了内存统一寻址和算力无缝调用,通信带宽大幅提升,延迟显著降低,从根本上解决了张量并行等紧耦合任务中的通信瓶颈。同时,多个AI计算节点再通过InfiniBand或RoCE等高速网络互联,便组成了可近乎线性扩展的万卡级乃至更大规模的算力集群,为大模型训练提供了强大的算力基础。 这种架构的革新,源于对一系列核心技术的深度整合与突破。在硬件层面,业界正通过“CPU+GPU+专用加速器”的异构计算和Chiplet先进封装技术,在突破单芯片算力瓶颈的同时,构建起超高密度的计算硬件。在存储层面,高带宽内存(HBM)和CXL内存池化技术成为打破“内存墙”的关键,为计算核心提供了源源不断的“数据燃料”。在网络层面,一个覆盖节点内、节点间乃至跨集群的“超低时延网络”体系正在形成,确保海量数据在数千乃至数万颗芯片间高效流通。而智能算力调度与绿色低碳供能技术,则分别从软件和能源维度保障了这套复杂系统的资源利用效率和可持续运行。 这些技术突破正快速转化为强大的生产力,赋能多样化的应用场景。首先,在大模型训练场景,AI计算节点已成为支撑万亿参数模型高效训练的基石,业界厂商如新华三、浪潮、华为等已相继推出单柜集成64卡甚至640卡的高密节点产品,显著提升了训练效率和稳定性。其次,在高并发推理场景,面对生成式AI的实时响应需求,AI计算节点通过异构资源利用和动态调度,有效降低了推理时延和成本,保障了服务的流畅体验。更重要的是,在金融风控、工业质检、能源调度等关键行业,AI计算节点正从通用算力走向“行业定制”。例如,在金融领域,它能将模型推理延迟压缩至毫秒级,实现实时反欺诈;在工业质检中,它能同步处理上百个工业相机的高清图像,完成微米级缺陷的秒级识别;在能源领域,它支撑起融合多源数据的智慧调度平台,提升新能源消纳效率和电网运行安全。 当前,AI计算节点的产业生态已步入从“硬件性能单点竞赛”向“软硬件生态综合体系”竞争的关键阶段。国际上,以英伟达为代表的厂商凭借先发优势和强大的软硬件生态形成引领,而AMD、博通等则通过开放联盟和技术标准制定推动生态的多元化发展。在国内,面对复杂的竞争环境,产业界探索出了一条“系统级创新”的特色路径。芯片厂商如寒武纪、海光等持续攻坚,云厂商和运营商如腾讯、阿里、中国电信等则通过自研互联协议、建设大规模集群,并结合开放标准(如UALink、ETH-X项目),以“自主核心+开放接口”的模式,积极构建一个从底层芯片到上层应用,多主体协同、开放兼容的自主产业生态。 展望未来,AI计算节点的发展将呈现几大明确趋势。政策层面将持续聚焦自主创新与产业链协同,推动我国算力从规模扩张向高效化提升转变。技术层面将围绕高效互联与高密集成持续演进,全柜级深度集成、训推一体架构、光互连技术以及全液冷方案将成为主流。产业格局将走向头部引领与多方协同,商业模式从硬件销售向“算力即服务”的一体化解决方案转变。最终,行业应用将从试点示范向全域渗透迈进,通过与生物医药、智慧城市等垂直领域的深度结合,AI计算节点将从一个基础的算力供给中心,升级为驱动千行百业智能化转型的“核心生产工具”,真正成为数字经济与实体经济深度融合的坚实底座。 (责任编辑:admin) |

- 上一篇:OFweek电子工程网

- 下一篇:环旭电子股份有限公司2025年年度报告摘要